自動駕駛的長尾問題

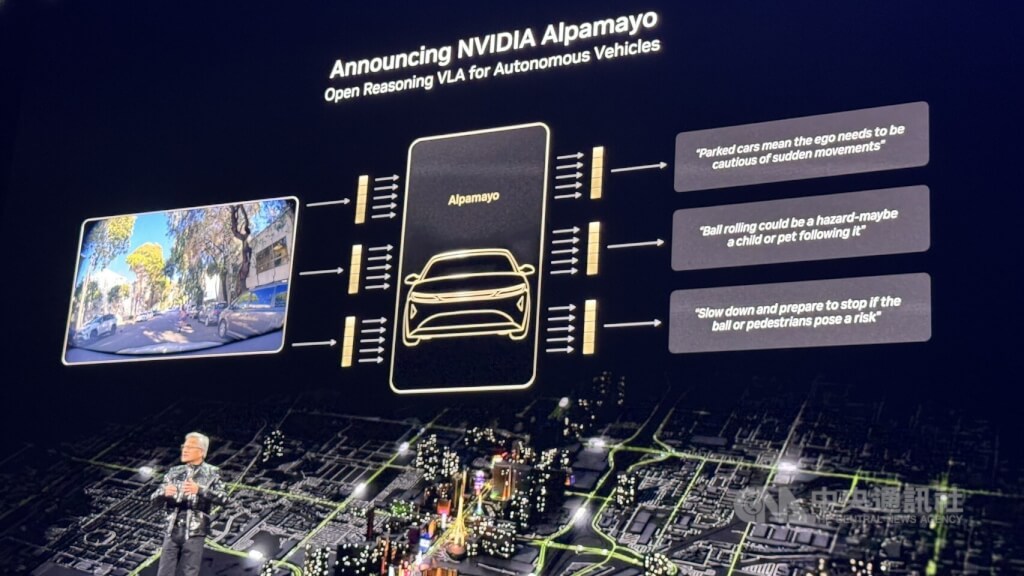

黃仁勳昨天在2026年國際消費電子展(CES)的演講中宣布:NVIDIA將推出世界上第一個會思考、推理的自動駕駛AI模型Alpamayo。

由於它是採用視覺–語言–行動(Vision-Language-Action, VLA)模型,能根據相機的輸入做出判斷,並即時動作,和特斯拉全自駕系統走的是同一路線;又是採取開放式架構,不但和各大車廠合作,更瞄準Robotaxi市場,因此被視為劍指特斯拉。

對此,特斯拉執行長馬斯克很快在社群平台X上回應道:「好吧,這正是特斯拉在做的。他們會發現,達到99%很容易,但要解決分佈的長尾問題卻非常困難。」

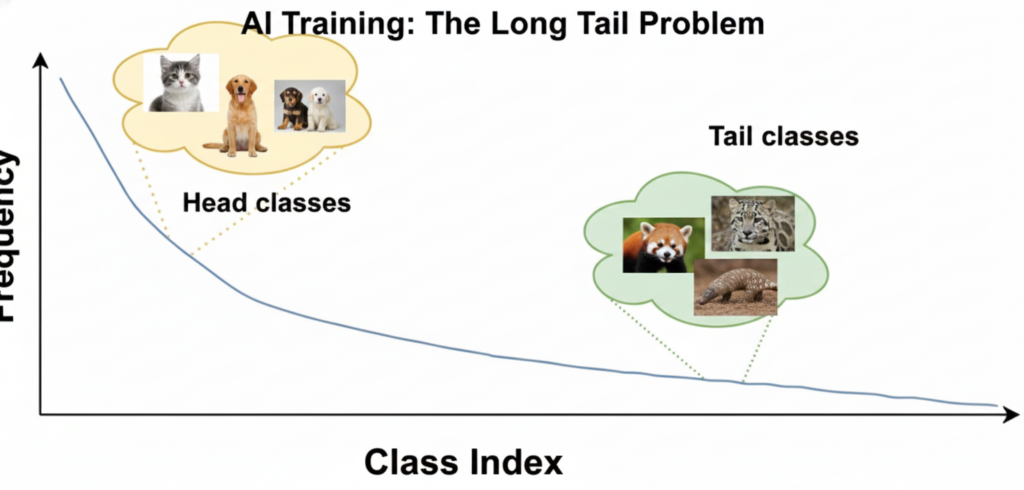

統計學中有個「帕雷托法則」(Pareto principle),也就是俗稱的80/20法則——80%的比重來自20%的項目;而其餘80%的項目雖然繁多,所佔的份量卻不高,這部分就稱為「長尾」。

在餵資料給AI模型進行訓練時,就會遇到長尾問題。以動物這個類別來說,大部分的圖片都是貓、狗,這樣訓練出來的AI可能就無法有效識別其他動物。

在自動駕駛領域也有長尾問題,有些情境在日常駕駛中極少發生,例如特殊的道路標誌、不應該出現的物體,或是異常的交通行為等,這些倘若AI未曾學習過便很可能產生誤判。

幾年前有則國內新聞:一台特斯拉以自駕模式在高速公路行駛,竟一頭撞進橫倒在路面的貨櫃。這便是長尾問題,因為它不曾見過這種情況。我自己的特斯拉Model 3也有過兩次誤判,一次是三年前在肯德基drive-thru的車道上,過個彎時眼前出現鐵皮屋,它以為是貨櫃車。

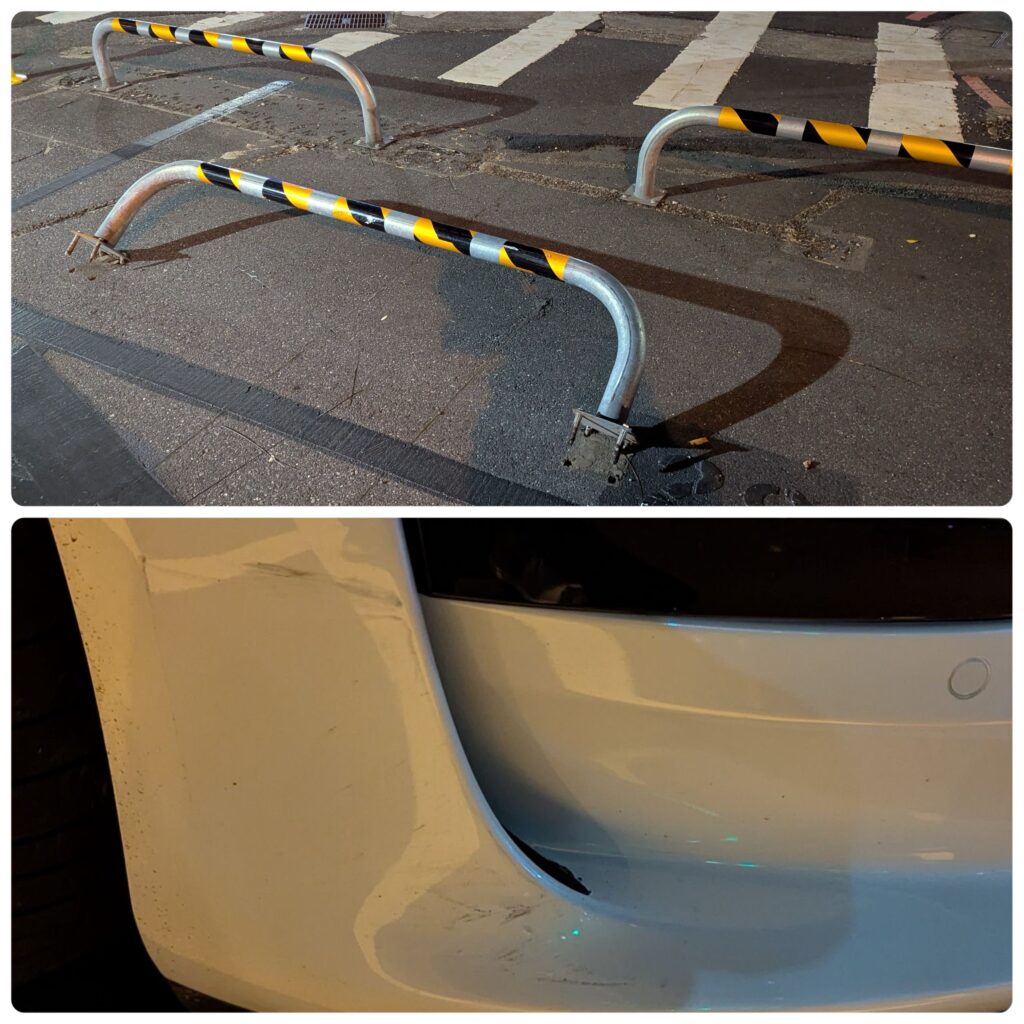

另一次就在上個月,讓它自動停車到停車格時,竟認不得地上的ㄇ字型擋桿,直接撞了過去。

馬斯克說解決長尾問題非常困難,卻又自信滿滿特斯拉無需駕駛人監督的全自駕系統很快就會上路。究竟特斯拉是否真能完全應付那1%極端罕見的情境,且讓我們拭目以待;但可嘆的是,受限於台灣的法令,只怕屆時也無法體驗啊。